Дрейф на поведението: Как да следим „здравето“ на ИИ моделите в реално време

За разлика от традиционния софтуер, изкуственият интелект е непредвидим. Една и съща заявка днес може да даде брилянтен резултат, а утре – пълна безсмислица. Според анализ на Дера Онуора (Microsoft) за VentureBeat, това налага създаването на изцяло нов стандарт за наблюдаемост (observability), наречен „AI Evaluation Stack“ [1].

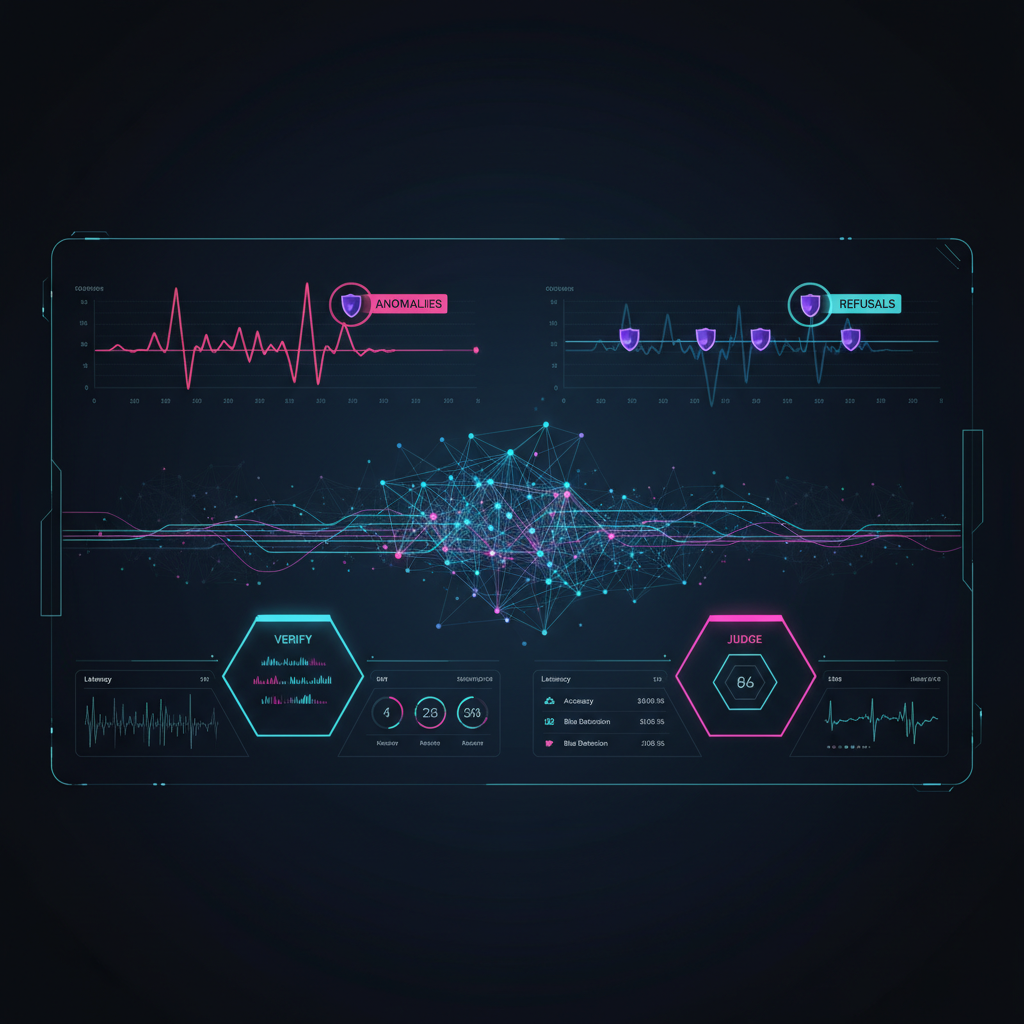

Основният проблем, пред който са изправени компаниите, е т.нар. дрейф на моделите (model drift) – влошаване на качеството на ИИ отговорите, което често се случва „тихо“ след актуализации на облачните API от страна на доставчици като OpenAI или Anthropic.

Изображение: Генерирано чрез Svetni.me AI

Трите критични сигнала

Ефективният мониторинг на LLM трябва да се фокусира върху три основни области:

- Дрейф на поведението (Behavior Drift): Промени в тона, точността или способността за следване на инструкции. Ако моделът спре да връща данни в правилния JSON формат, това е сигнал за критичен дрейф.

- Модели на отказ (Refusal Patterns): Когато ИИ започне твърде често да отговаря с „не мога да направя това“. Това често показва свръхкалибрирани филтри за безопасност, които блокират напълно легитимни бизнес заявки.

- Скрити повторни опити (Retries): Потребителите рядко дават обратна връзка с палец надолу. Вместо това те просто натискат бутона за прегенериране. Високият процент повторни опити е най-сигурният индикатор за неудовлетвореност [1].

ИИ като съдия

Статията предлага хибридна архитектура за защита. Първият слой е детерминистичен – стандартен код, който проверява структурата на изхода. Вторият слой обаче е по-интересен: използването на „ИИ като съдия“ (LLM-as-a-Judge). По-мощен модел (като GPT-4o или Claude 3.5 Opus) се използва за асинхронна проверка на работата на по-малките модели в реално време, оценявайки тяхната вежливост и полезност по строга скала.

Пътят към надеждността

За да излязат от фазата на „прототипа“, компаниите трябва да поддържат т.нар. „Golden Dataset“ – еталонен набор от 200–500 проверени от хора случаи, срещу които моделите се тестват преди всяко обновяване.

В свят, в който автономните агенти и RAG системите стават все по-сложни, способността да разберем защо ИИ е променил мнението си, се превръща в най-важното умение за инженерите на бъдещето.

Източници:

[1]: Monitoring LLM behavior: Drift, retries, and refusal patterns - VentureBeat